机器学习的本质

- 自动寻找一个函数的能力

类别

- Regression: The function outputs a scalar

- 寻找一个具体数值

- Classification: Given options(class),thr function outputs the correct one

- 从选项中进行选择

- Structured Learning: create somrthing with struction

- 让机器创造具有结构性的输出

研究步骤(Linear Model)

假设Model(猜测关系)

- Based on Domain Knowledge

- Model ( weight/bias ): a function

定义Loss(确定Model好不好用)

- Loss: a function, how good a set of value is

- Label: 正确的数值

- Feature: 一个特征,一个可能影响结果的数值

- MAE(mean absolute error): |y-y^|

- MSE(mean square error): (y-y^)^2

最佳化问题(Optimization)

- Gradient Descent: 一种常用的optimization的方法,计算最佳w,b

- Hyperparameters: 机器学习中需要自己设定的值

- Global minima: LossFunction真正的最低点

- Local minima: 微分值为0但并非最低点

- Error Surface: 将Loss函数绘制为权重

优化第一步:预测模型优化

- 突破Model Bias

- Linear Model有很大限制(Model Bias)

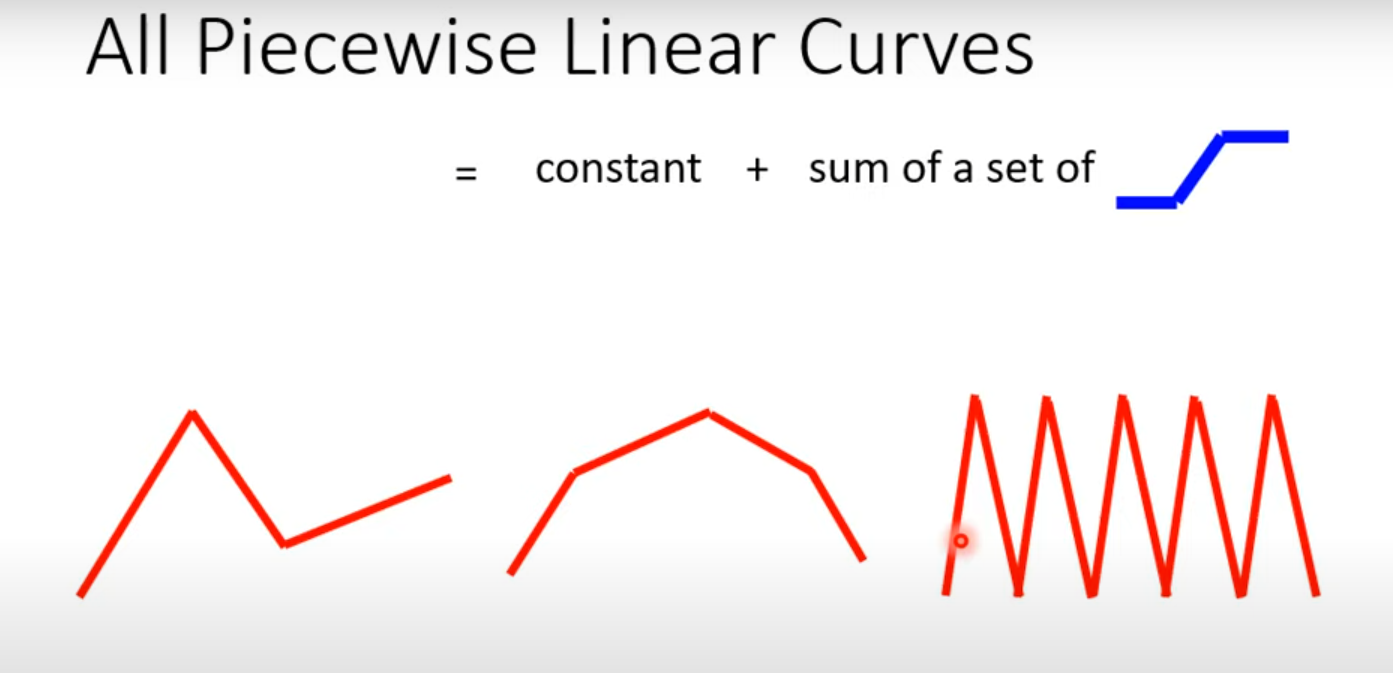

- Piecewise Linear Curves = constant + sum of a set of (blue curve)

- 曲线也可以转化为piecewise linear

- 曲线也可以转化为piecewise linear

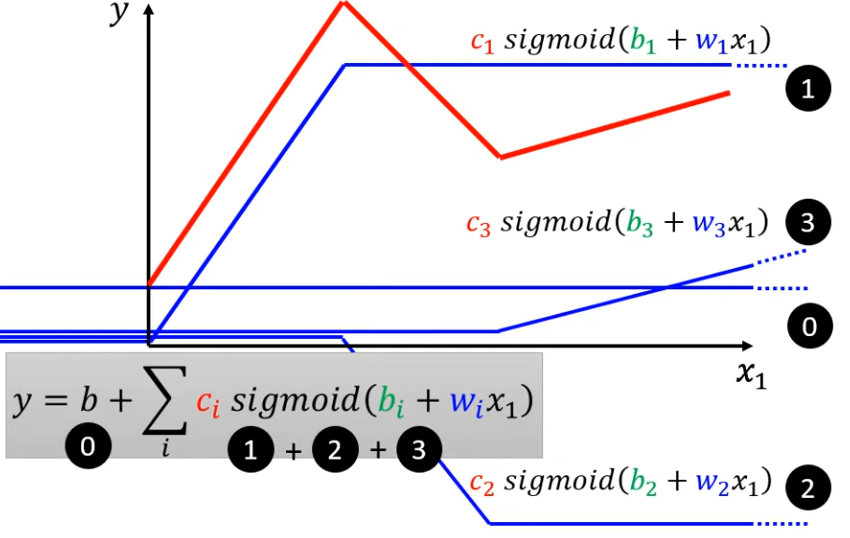

- 寻找Blue Function

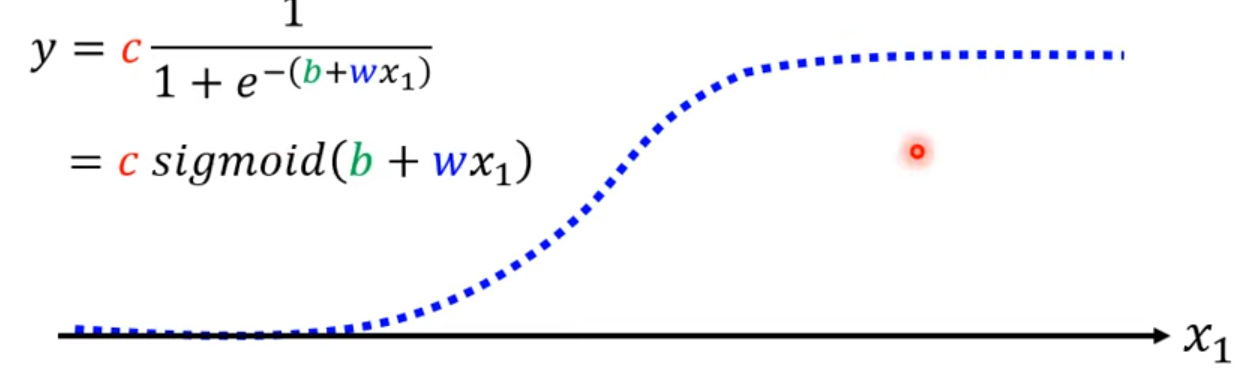

Sigmoid Function (S型Function)

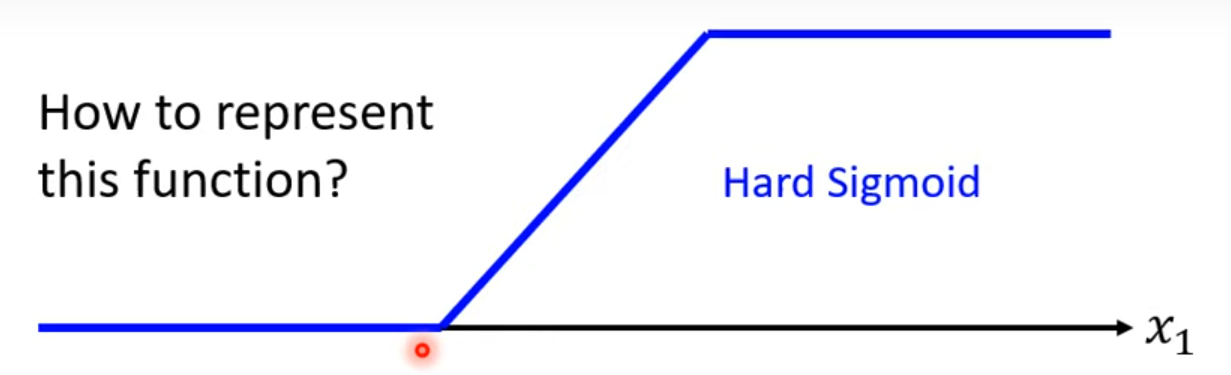

Hard Sigmoid

w/b/c: Change slopes/shift/height

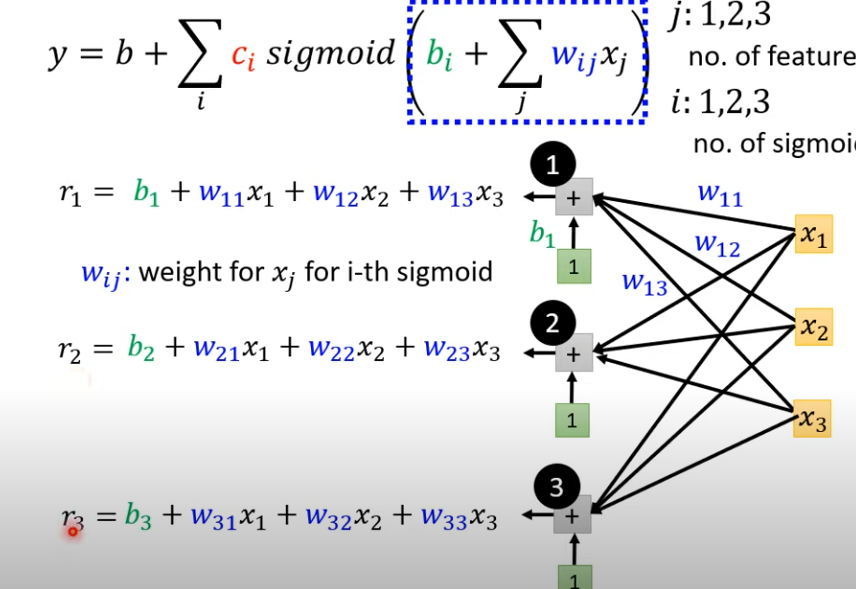

最终的方程(针对piecewise linear function)

计算展开(更加直观辣)

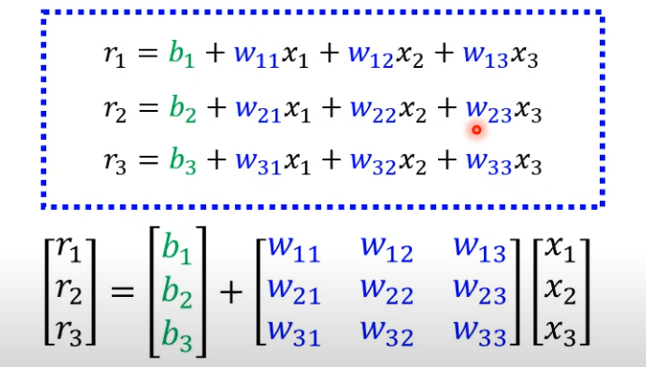

用矩阵表示结果

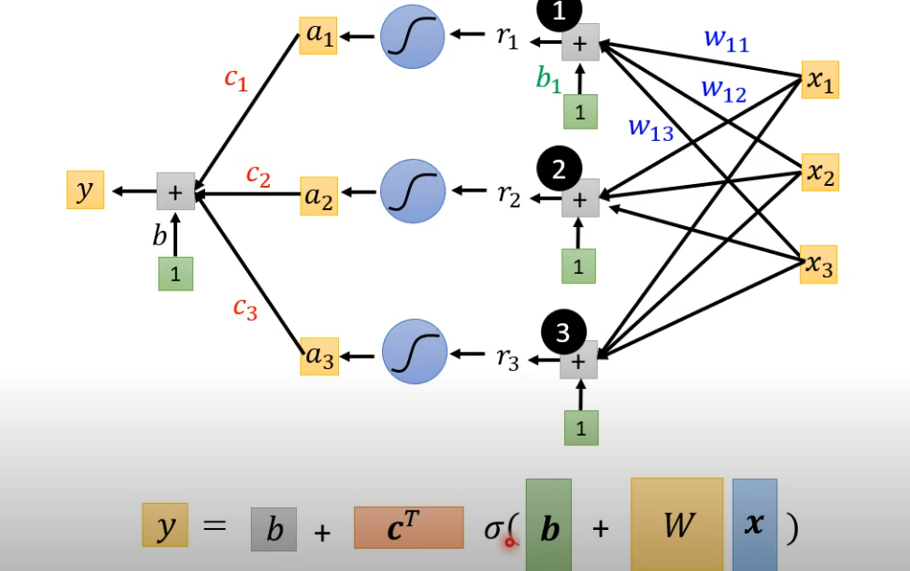

最终结果

$\theta$: 将所有未知变量放在一个列向量中

优化第二部步:根据新模型更改Loss

- Gradient: 所有变量微分值所组成的列向量

- 写作 g=▽L ( $\theta$ $^0$ )

- Update: 每一次更新参数

- Epoch: See all the batches once

- 一个epoch通常包含多次update

优化第三步:反复多做几次

以a为参数再进行修正

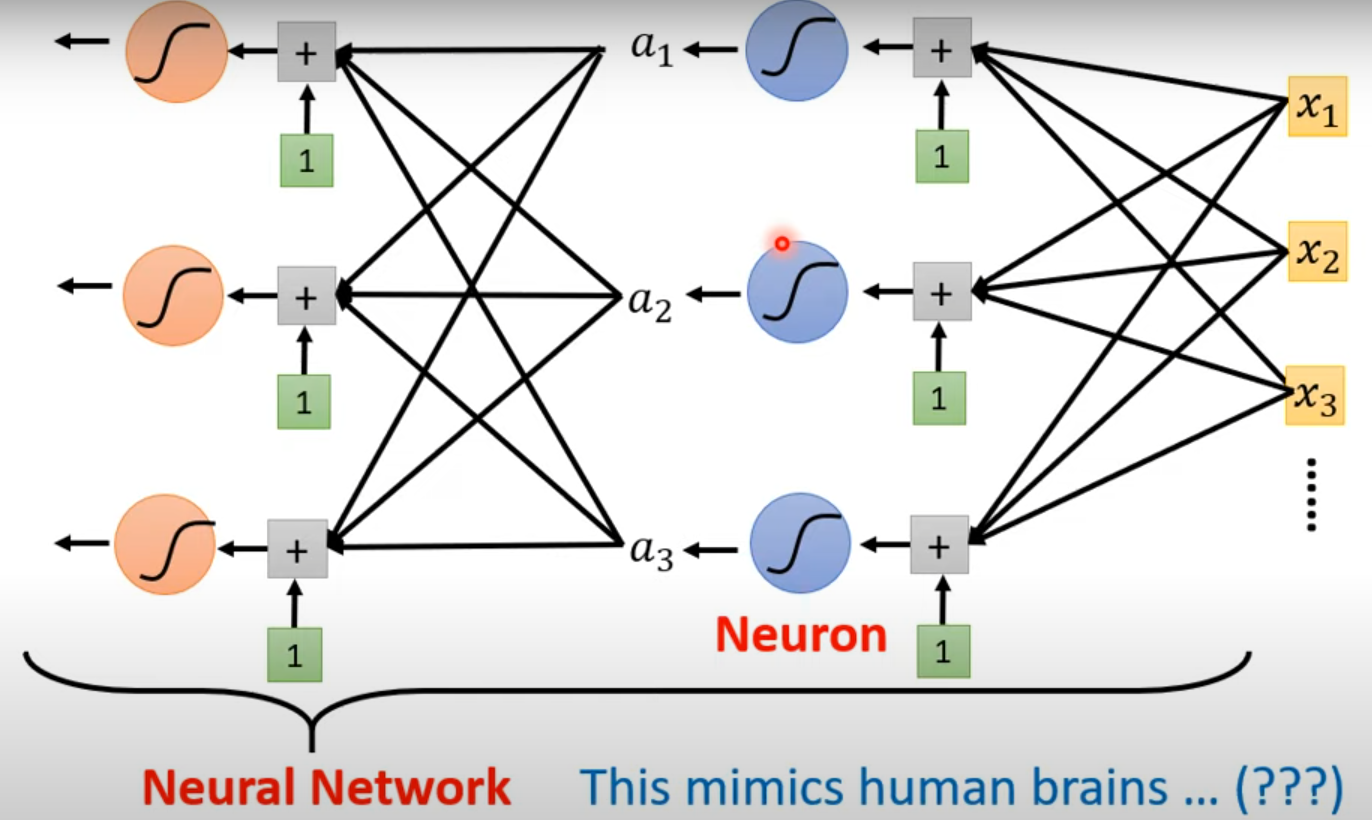

神经网络(Neural)

每一次反复都是一层layer

Overfitting:过拟合